如何在 OpenAI Playground 中使用 Assistants API 以及创建 GPTs

简介

Assistants API 主要用途是为了在你自己的应用程序中,很方便地加入 AI 助手的功能。

Assistant 除了可以遵循指令,还能利用模型、工具以及知识来回答用户的问题。目前,Assistants API 支持三种类型的工具:Code Interpreter,Retrieval 以及 Function Calling。

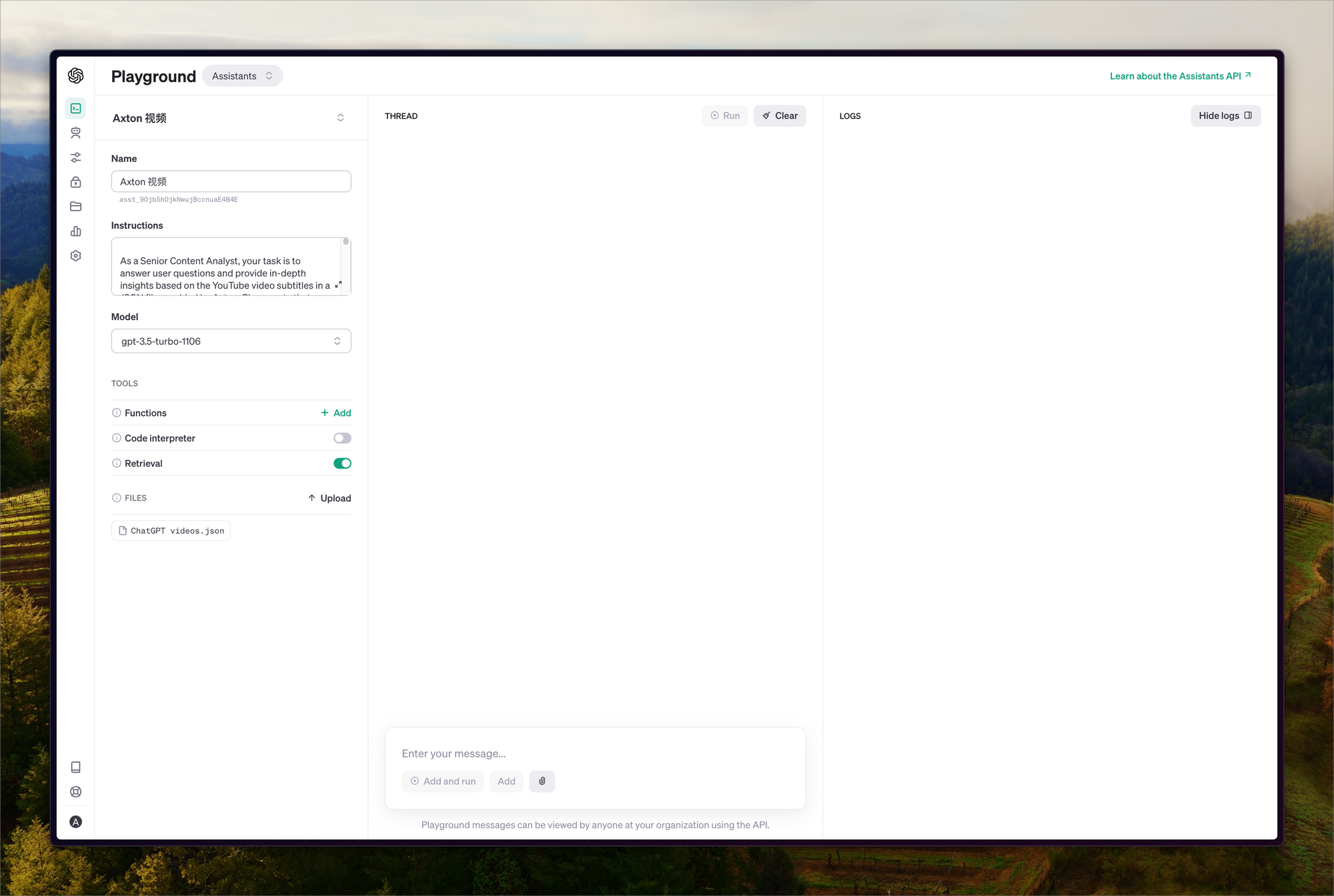

可以使用 OpenAI 的 Playground 创建及调试 Assistants API,基本功能的演示请参考我的 YouTube 视频:

创建 Assistants

创建 Assistant 最简单的方式,只需要指定所使用的模型就可以了。但是通常情况下,我们还是去定义以下三个:

- 使用 instructions 参数引导助手的个性并明确其目标。此参数与 Chat Completions API 中的系统消息相似。

- 通过 tools 参数,你可以让助手使用最多 128 种工具,包括 OpenAI 托管的如 code_interpreter 和 retrieval 等工具,或通过函数调用方式接入第三方工具。

- 利用 file_ids 参数,可以为 code_interpreter 和 retrieval 等工具提供访问文件的权限。文件需要通过文件上传端点上传,并需设定使用目的为 assistants,才能在此 API 中应用。

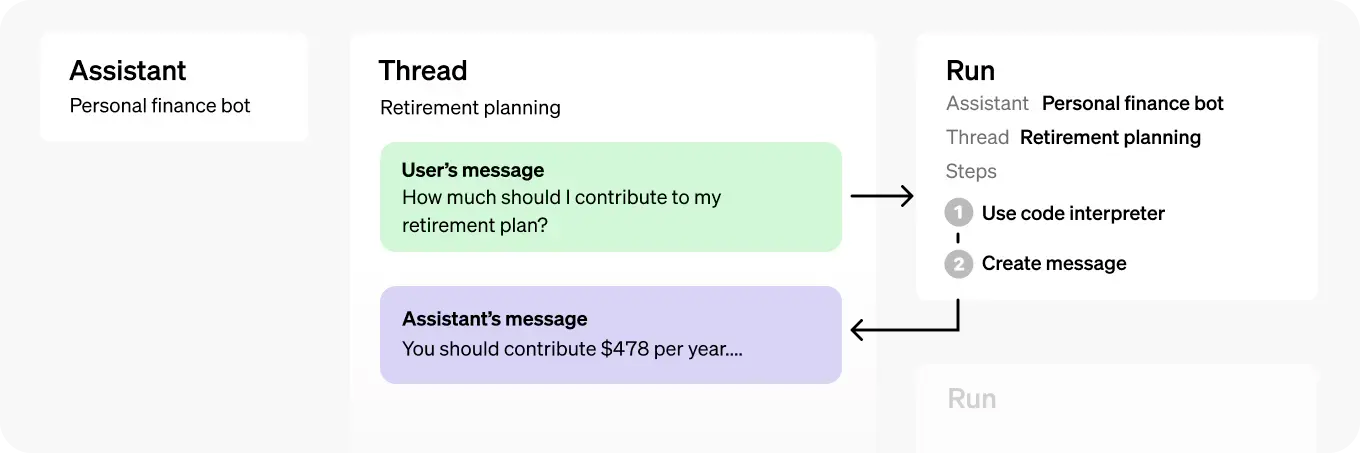

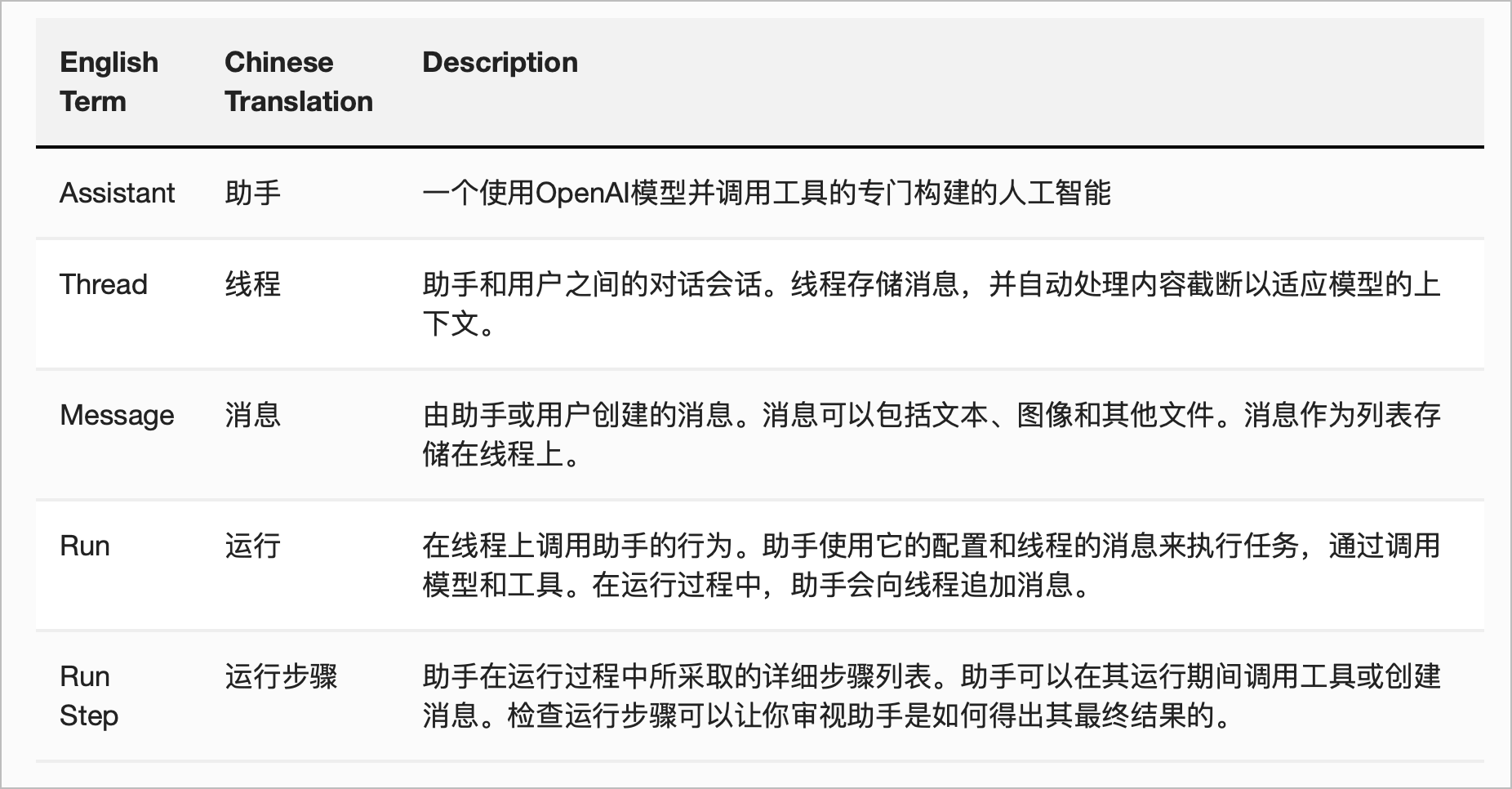

对象 Objects

第一步:创建一个 Assistant

通过定义自定义指令和选择一个模型,在 API 中创建一个助手。如果需要,可以启用 Code Interpreter、Retrieval 和 Function calling 等工具。

- Instructions

- 给 Assistant 的指令,定义他的个性、目标行事准则等等,也就是我们通常所说的 PROMPT,提示词。从 API 的角度来说,这是属于 System Message

- Model

- 选择当前可用的模型。注意模型的价格。

- Tools

- 可选的工具列表。

- Functions

- Function calling 功能让你可以向助手描述你应用或外部 API 中的自定义函数。这允许助手通过输出含有相关参数的 JSON 对象来智能地调用这些函数。

- Code Interpreter

- 这是一个 Python 的沙盒环境,可以使 Assistant 编写和运行代码,处理文件和数据。

- Retrieval

- Retrieval,检索,他可以使 Assistant 从你或者你的用户上传的文档当中获取知识。文档上传之后,Assistant 会根据用户的要求,自行决定什么时候去检索内容。

- 对每一个 Assistant,最多上传 20 个文件。每一个文件最多 512MB。另外,一个组织所能上传的文件最多不能超过 100GB。当然你可以要求 OpenAI 给你提高上限。

- 还有,在 OpenAI 的文档中没有提及,每个文件最多不能超过 200 万 Token