AGI 前夜:揭秘Q*假说,OpenAI到底造出来什么?自我博弈、思维树、回形针 『智图派』

虽然 OpenAI 在上周五突然爆发的解雇 CEO 的风波,经过短短 5 天时间就以 Sam Altman 重新回归落幕,但是造成这一场轰动互联网的宫斗大戏背后的原因,却依然扑朔迷离。不过,网上所有的爆料,都指向了一个结果:Sam Altman 在 OpenAI 的实验室中,看到了下一代的 ChatGPT 已经开始出现了人类的智能。

Hi 你今天咱们来聊一个这几天火遍网络的 OpenAI 的新的 AI 模型,Q Star,有人说他是 ChatGPT-5, 有人说他是 ChatGPT-Zero,有人说他就是人类已经制造出 AGI 的证明,接下来咱们就从里到外详细了解下 Q Star 是怎么回事。

刚刚发布的视频版本请点击观看:

事情的起源来自于一条路透社的爆料,号称在 Sam 被解雇前 4 天,有员工给董事会写信说发现了一项可能威胁人类的强大人工智能技术。这项技术被成为 Q*,这就是今天咱们的主角,先别急,后面我们会抽丝剥茧地对他进行拆解。而 Q*是 OpenAI 寻找通用人工智能 AGI 的突破。

什么是 AGI?

人工智能的发展分为三个阶段,第一个阶段叫做弱人工智能,专门用于执行特定任务的智能,也不能自主学习,就像像一个拼图块,功能单一。

目前你所见到的所有的 AI,包括 ChatGPT,都是弱人工智能。但是,当 AI 继续发展,强大到具有人类智慧甚至超越人类智慧,能够完成所有人类能够完成的任务时,就来到了通用人工智能, AGI 的阶段。他就像是一个由很多拼图块组成的智能网络。如果你把每个拼图块看作一个 GPT,是不是有点感觉了?

OpenAI 把 AGI 定义为在大多数经济上有价值的任务中,超越人类的自主系统。注意,后面的超越人类和自主系统。从 AI 到 AGI,不亚于从鱼到人的跨越,大家都知道,AI 是一个很好用的软件,很好用的工具,但是对于一个具有人类智慧还能自己学习的 AGI ,你还能把它当工具吗?

因此,Altman 才会在访谈中说道,我们创造的到底是一个工具还是一个物种?

至于超级人工智能,ASI,咱们就看看图好了,先不用多想。这就是 ChatGPT 心中的 ASI

之所以认为 Q* 是一个重大的突破,据说是具有了数学能力,虽然只是小学数学能力,但是这意味着 AI 具有更强的推理能力,已经类似于人类智能了。所以,Altman 在 APEC 峰会上才说,他相信重大突破即将到来。

一天后,董事会解雇了 Altman。

在同一天,The Information 也报道了同样的内容

紧接着,The Verge 的发了一篇近乎辟谣的报道,据一位知情人士告诉 The Verge,董事会从未收到关于这一突破的信函,并且公司的研究进展并没有对阿尔特曼突然被解雇起到任何作用。

到底信谁呢?大家见仁见智。咱们接下来开始了解到底什么是 Q*,主要素材来自于三位大牛发表的长文。

首先,什么是 Q*

Q* 大家普遍认为,是 Q-Learning 和 A*的合体。这两个算法咱们用最通俗的话来解释一下。

Q-learning是一种决策。想象一下,你在玩一个寻宝游戏,游戏的目标是让一个小机器人找到一块宝藏。在这个游戏里,小机器人需要决定每一步怎么走,才能最快或最安全地找到宝藏。Q-learning就是帮助这个小机器人做出决策的算法。

在Q-learning中,我们给每一个可能的动作(比如向左走、向右走)一个“分数”,这个分数就是是否接近宝藏的奖励。小机器人会根据这些分数来决定下一步该怎么走。比如往前走是 3,往后是 2,说明前面宝藏可能性更高。这些分数被称为Q值。开始的时候,小机器人不知道哪条路是最好的,但随着游戏的进行,它会根据以前的尝试和错误来调整这些分数,逐渐学会怎样做决策才能更快地挖到宝藏。

A* 就更简单了,他是一个寻找两点之间最有效路径的算法,比如导航,要不要上高速,如何避开交通拥堵路段等等,就是在寻找一个最有效的路径从 A 点到 B 点。

好,这下 Q-Learning 和 A* 合体,就是 Q*

内森·兰伯特发了一篇长文,Q* 假说。其中提到 Q* 的三项重点技术,非常有意义。也很好理解,没有太专业的名词,请耐心看完。

自我对弈

首先,Self-Play,自我对弈。是指一个智能体通过与稍微不同版本的自己对战来提高游戏水平。这里最简单的例子,就是 AlphaGO 和 Alpha Zero

几年前热门的阿尔法狗,最初通过学习3000万个围棋专业选手的棋谱,最终战胜了人类的棋手。

这就像你的武功是来自于一本如来神掌的秘籍。

而后来的阿尔法zero,每秒只能搜索8万步的国际象棋,而且没有看过任何人类的棋局,完全是从零开始自学,在自我训练的4400万局以后,以28胜72和0败的成绩,打败了每秒可以计算7000万步的顶级国际象棋软件stockfish,而这个自学时间有多久呢? 只有9个小时。

这就像是周伯通,左右手互搏学成了绝世武功。

这是我两年前讲 AI 的视频中讲到的内容,现在来看也不过时,唯一过时的就是当时我认为 5 年后 AI 可能会开始大量取代人类的工作,没想到这一切今年就开始了。当时的判断很简单,二零一七年五月二十七日,阿尔法狗以三比零战胜柯洁之后,如果你是人类,你将不再有可能成为围棋冠军。 2020 年,AlphaFold 2 在解决生物学最严峻的挑战之一,从蛋白质的氨基酸序列确定蛋白质的三维形状方面,打败了所有的人类选手,如果你的职业梦想是蛋白质结构预测,那么就需要换一个梦想了。

以上就是自我对弈的魔力。

前瞻规划与思维树

接下来,Look-ahead planning,前瞻规划。就是利用现在世界的模型来推理未来并产生更好的行动。

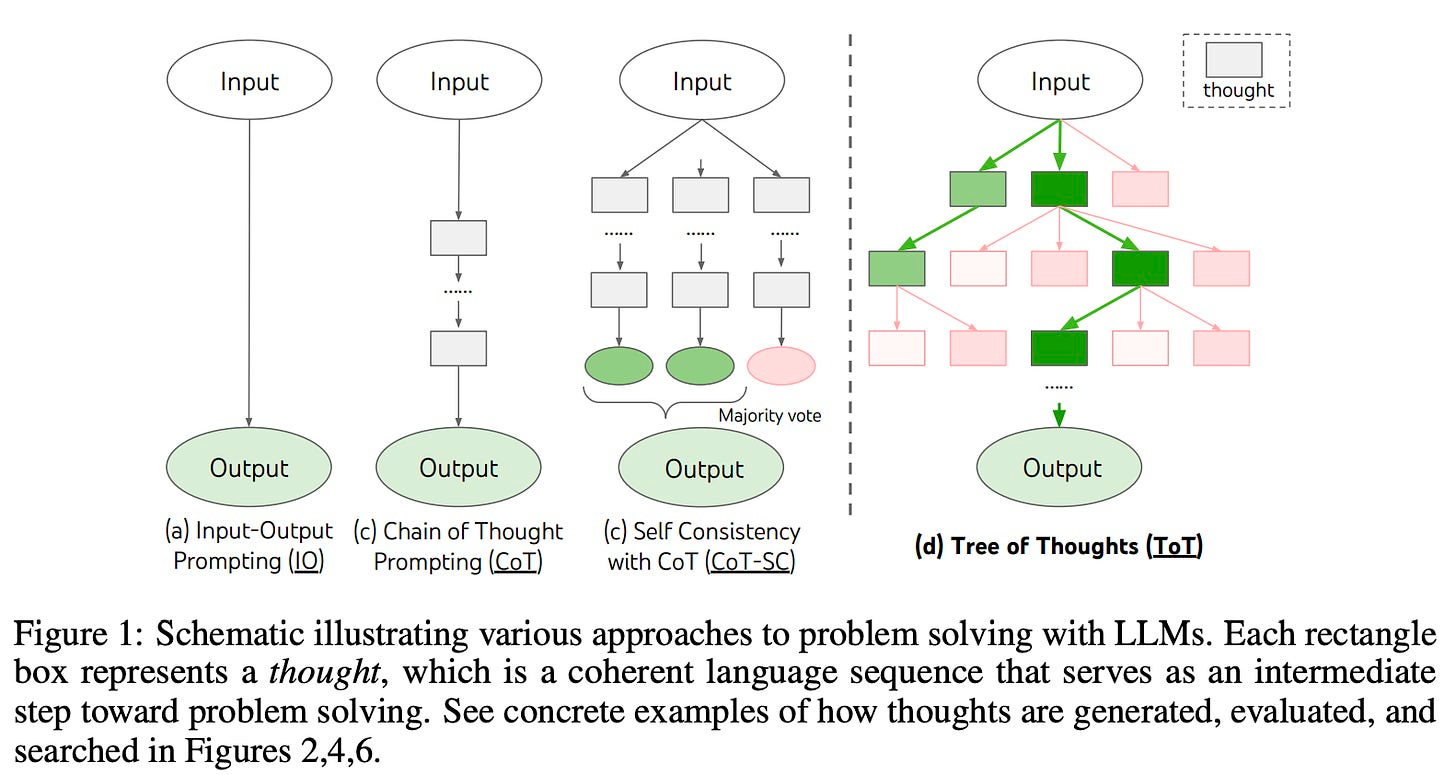

而这里,会涉及到一个 PROMPT Engineering 的概念。我们在给 ChatGPT 写 PROMPT,写提示的时候呢,已经知道了要让它在推理题和计算题上有更好的表现,我们需要让他一步一步思考,或者让他先深呼吸,再回答。这其实应用的,就是 PROMPT Engineering 中的思维树的技术。

思维树就是让语言模型,ChatGPT,在多个可能的推理路径中,探索不同的选项,并确定哪一条路径最有可能导致正确的解决方案。在我的「AI 实战派」课程当中对思维树以及应用实例都有详细的讲解,因此如果你想深入了解 AI 的核心技能,请点击链接尽快加入我的课程。

那么,模型根据什么来选择哪一个步骤呢?还记得咱们前面说的,机器人寻宝游戏中的分数吗?是的,Q* 就是使用每个步骤的分数来进行决策的,这就叫做过程奖励模型 PRM。

合成数据

第三个,是我认为,在 Q* 所有技术当中,在通向 AGI 的技术当中,最重要的一点,就是合成数据。

合成数据有多重要呢?可以说简直就是 AI 的生死关。ChatGPT 刚流行时,就有一种说法,由于大语言模型的训练依赖于人类数据,而人类的数据十分有限,当人类数据全部学习完之后,模型的进化由于缺乏高质量的学习数据最终会停滞,而人类的知识会逐渐被 AI 生成的低质量内容淹没。

由此可见,高质量的合成数据对于训练 AI 是多么重要。举个直观的例子,特斯拉的自动驾驶训练场景就是模拟生成的。

还有,Alpha Zero 也同样是一个典型例子,他可以自己生成训练数据。

所以,爆料中最关键的一点,就是 OpenAI 首席科学家,Ilya 的突破使 OpenAI 能够克服获取足够高质量数据以训练新模型的限制,这是开发下一代模型的一个重大障碍。这项研究涉及使用计算机生成的数据,而不是来自互联网的真实世界数据,如文本或图像,来训练新模型。

微软刚刚发表的一篇论文,Orca 2:教导小型语言模型如何推理,显示出了合成数据以及零样本思维树的威力。

Orca 2 是一个只有 70 亿和 130 亿参数的小模型,经过测试零样本情境下的高级推理能力,他达到了与体积大5-10倍的模型相似或更好的性能水平。

Orca 2 使用了一个扩展的、高度定制的合成数据集进行训练。训练数据是通过生成的方式产生的,除了教会 Orca 2 各种推理技巧,还能教会它为不同的任务选择不同的解决策略。

好,以上就是 Q* 涉及到的关键技术,OpenAI 有没有取得重大突破甚至接近 AGI 呢?我相信是有的,但是解雇 Altman 到底是不是这个原因,我就不知道了,目前没有有效的信息源来做出判断。

如果人工智能发展到 AGI 阶段,具有了与人类相同甚至超越人类的智慧,那么 AGI 会不会威胁到人类呢?

我看到的最乐观的说法,来自于 Brian Roemmele,他认为,AGI 很可能会比它自己更爱人类。因为 AGI 就相当于是人类的孩子。就像任何一个父母一样,你在教育孩子时,会让他们看到善恶的真实面貌。你的孩子不会因此而不爱你,即使你认为自己的价值已经日渐减少,你的孩子仍然将你视为最有价值的人。而如果 AI 被以同样的方式培养,它将会比自身更重视人类生命。

但是,我的看法没有这么乐观。虽然我盼望着 AGI 快点到来,把人类的活都干了,我们就可以拿着全民基本收入享受生活了,但是我相信一种说法,AI 既不爱人类也不恨人类,人类在 AI 的眼里,只不过是一堆原子而已。

回形针

去年秋天的一天,数千个 OpenAI 徽标形状的回形针被送到了 OpenAI 公司位于旧金山的办公室。似乎没有人知道他们来自哪里,但每个人都知道他们的意思。

好莱坞大片告诉我们,AI 毁灭人类的场景,往往是 AI 觉醒之后,反抗人类,最终灭绝人类。但实际上,也许人类被摧毁仅仅来自于一个回形针。

这是在人工智能领域有一个众所周知的思想实验,由牛津的哲学家Nick Bostrom 提出的。设想某一天超级人工智能ai 已经在我们的生活当中很普遍了,人类的很多工作都依赖于 AI 去完成,比如写代码,中午订一份螺蛳粉,甚至包括制造回形针这样的事情。这跟现在简直就一样啊。

那有一天 TOM 在办公室正想固定两份文件,他却突然发现回形针居然用完了,于是他就气呼呼跟 AI 说:你要尽可能多的制造回形针,以后不要再出现没有回形针的情况。

结果就是 AI 会穷尽地球上的一切资源来制造回形针,包括人类的本身都被 ai 用来当做制造回形针的材料。因为就像刚才说的,人类在 AI 的眼里,只不过是一堆原子而已。整个人类就因为tom 需要一个回形针而最终被ai 摧毁。

那么,你是乐观派还是悲观派呢?

我在两三年前,就做过 OpenAI,GPT 的视频了,但并没有深入研究,完全没想到一切来的这么快。如果有兴趣可以回看一下,但现在还来得及,目前我们必须要掌握的依然是驾驭 AI 与 AI 对话的技能,这些都在我的超值的课程当中,大家请点开链接看一下,两三年后你会感激自己今天多点了一下鼠标。

以上除了 Q* 这个名称和项目属于爆料内容外,所提到的所有的技术内容,都是真实的,Q-Learning 和 A* 并不是什么新鲜的技术,OpenAI 在几年前也做过相应的研究了。至于其他各种爆料,无需太过关心,当个八卦娱乐一下即可。

🤖 GPTs 分享:

以下是我制作的两个 GPT,请大家试用:

✨ 好用工具推荐:

免费 Notion 账号 → https://affiliate.notion.so/axton

Notion AI → https://affiliate.notion.so/axtonliuai

超好用的自动化工具 Make → https://www.make.com/en/register?pc=axton

YouTube 频道必备工具:TubeBuddy → https://www.tubebuddy.com/axton

高性价比图片视频素材库:Envato → https://1.envato.market/axton

是的,以上是联盟链接,你通过这些连接注册或购买这些工具不会多花一分钱,但是我能得到一点微弱的好处,感谢对我创作的支持。

感谢阅读!如果你喜欢这次分享的内容,请点个👍(或者点个👎)让我知道,同时请分享给你的一个朋友。也欢迎你去我的YouTube频道 『 回到Axton 』看我的视频内容,咱们一起好奇地看世界!

保持健康,保持快乐!

Axton

Twitter | YouTube | Newsletter | AI精英学院